Гамма-функция — математическая функция. Была введена Леонардом Эйлером, а своим обозначением гамма-функция обязана Лежандру.

Преобразование Бокса — Мюллера — метод моделирования стандартных нормально распределённых случайных величин. Имеет два варианта. Метод является точным, в отличие, например, от методов, основывающихся на центральной предельной теореме.

Тригонометри́ческие фу́нкции — элементарные функции, которые исторически возникли при рассмотрении прямоугольных треугольников и выражали зависимости длин сторон этих треугольников от острых углов при гипотенузе. Эти функции нашли широкое применение в самых разных областях науки. По мере развития математики определение тригонометрических функций было расширено, в современном понимании их аргументом может быть произвольное вещественное или комплексное число.

Распределе́ние Ма́ксвелла — общее наименование нескольких распределений вероятности, которые описывают статистическое поведение параметров частиц идеального газа. Вид соответствующей функции плотности вероятности диктуется тем, какая величина: скорость частицы, проекция скорости, модуль скорости, энергия, импульс и т. д. — выступает в качестве непрерывной случайной величины. В ряде случаев распределение Максвелла может быть выражено как дискретное распределение по множеству уровней энергии.

Фу́нкции Бе́сселя в математике — семейство функций, являющихся каноническими решениями дифференциального уравнения Бесселя:

Непреры́вное равноме́рное распределе́ние в теории вероятностей — распределение случайной вещественной величины, принимающей значения, принадлежащие некоторому промежутку конечной длины, характеризующееся тем, что плотность вероятности на этом промежутке почти всюду постоянна.

Распределе́ние Коши́ в теории вероятностей — класс абсолютно непрерывных распределений. Случайная величина, имеющая распределение Коши, является стандартным примером величины, не имеющей математического ожидания и дисперсии.

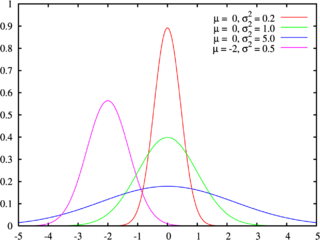

Пло́тность вероя́тности — один из способов задания распределения случайной величины. Во многих практических приложениях понятия «плотность вероятности» и «плотность (распределения) случайной величины» или «функция распределения вероятностей» фактически синонимизируются и под ними подразумевается вещественная функция, характеризующая сравнительную вероятность реализации тех или иных значений случайной переменной (переменных).

Распределе́ние Стью́дента в теории вероятностей — это однопараметрическое семейство абсолютно непрерывных распределений. Уильям Сили Госсет первым опубликовал работы, посвящённые этому распределению, под псевдонимом «Стьюдент».

Ме́тод максима́льного правдоподо́бия или метод наибольшего правдоподобия в математической статистике — это метод оценивания неизвестного параметра путём максимизации функции правдоподобия. Основан на предположении о том, что вся информация о статистической выборке содержится в функции правдоподобия. Метод максимального правдоподобия был проанализирован, рекомендован и значительно популяризирован Р. Фишером между 1912 и 1922 годами.

Кванти́ли распределе́ния хи-квадра́т — числовые характеристики, широко используемые в задачах математической статистики таких как построение доверительных интервалов, проверка статистических гипотез и непараметрическое оценивание.

Эллипти́ческий интегра́л — некоторая функция  над полем действительных или комплексных чисел, которая может быть формально представлена в следующем виде:

над полем действительных или комплексных чисел, которая может быть формально представлена в следующем виде:

,

,

Логистическая регрессия или логит-модель — статистическая модель, используемая для прогнозирования вероятности возникновения некоторого события путём его сравнения с логистической кривой. Эта регрессия выдаёт ответ в виде вероятности бинарного события.

Сопряжённое априорное распределение и сопряжённое семейство распределений — одни из основных понятий в байесовской статистике.

В комбинаторной оптимизации под линейной задачей о назначениях на узкие места понимается задача, похожая на задачу о назначениях.

Распределение арксинуса — распределение вероятностей, функция распределения которого имеет вид

Асимптотический анализ — метод описания предельного поведения функций.

Дивергенция Йенсена — Шеннона — это метод измерения похожести двух распределений вероятностей. Она известна также как информационный радиус или полное отклонение от среднего. Дивергенция базируется на дивергенции Кульбака — Лейблера с некоторыми существенными отличиями, среди которых, что она симметрична и всегда имеет конечное значение. Квадратный корень из дивергенции Йенсена — Шеннона является метрикой, которая часто упоминается как расстояние Йенсена — Шеннона.

![{\displaystyle [0,f(x)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4aab098c7371ce16e69a2e14b79228f7dc47e547)

![{\displaystyle f^{-1}[0,y]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ae0b8eaaacdbfd4b72ea6ebbaa2e72e2ce47303d)

![{\displaystyle [0,e^{-x^{2}/2}/{\sqrt {2\pi }}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3ca65a925f66e61e112e15df7a330f197be799ea)

![{\displaystyle [-\alpha ,\alpha ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d6aaee8f359da96b8f4b1c02a27cbdadf9adf313)