В математике и теоретической физике функциональная производная является обобщением производной по направлению. Разница заключается в том, что для последней дифференцирование производится в направлении какого-нибудь вектора, а для первой речь идёт о функции. Оба эти понятия можно рассматривать как обобщение обычного дифференциального исчисления.

Существуют два основных вида функциональных производных, соответствующих общему определению производной Фреше и производной Гато функции на банаховом пространстве. На практике они зачастую не различаются.

Определение

Пусть  — некоторый функционал, то есть функция, определённая на некотором множестве функций. Значение функционала

— некоторый функционал, то есть функция, определённая на некотором множестве функций. Значение функционала  на функции

на функции  обозначают

обозначают ![{\displaystyle F[\phi ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dd9fa24e7f45b9f56ab7b81433d1ff68e9bcb69a) . Его производная Гато (производная по направлению) есть предел (если он существует) выражения

. Его производная Гато (производная по направлению) есть предел (если он существует) выражения ![{\displaystyle \lim _{\varepsilon \to 0}{\frac {F[\phi +\varepsilon \delta \phi ]-F[\phi ]}{\varepsilon }}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/eee3e0955951685ebe8356bfc3f25ffbc1efc236) . Здесь

. Здесь  — некоторая функция из области определения

— некоторая функция из области определения  . Отметим, что такая производная, вообще говоря, зависит от выбора функции

. Отметим, что такая производная, вообще говоря, зависит от выбора функции  . В этом смысле ситуация вполне аналогичная конечномерной. Например, функция

. В этом смысле ситуация вполне аналогичная конечномерной. Например, функция  дифференцируема в точке

дифференцируема в точке  справа и слева, но эти односторонние производные различны, а в обычном смысле эта функция в 0 не дифференцируема.

справа и слева, но эти односторонние производные различны, а в обычном смысле эта функция в 0 не дифференцируема.

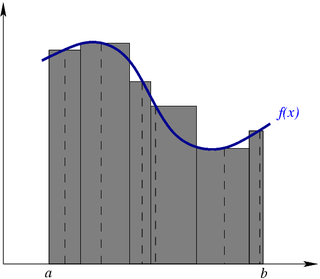

Гораздо чаще в приложениях возникает производная функционала, аналогичная классической конечномерной производной и являющаяся частным случаем производной Гато. Не давая общего определения, рассмотрим типичный пример: поиск экстремума функционала на множестве траекторий, проходящих через две заданные точки. Такая задача возникает при исследовании задач классической механики с помощью принципа наименьшего действия, подобного же типа задача о нахождении фигуры максимальной площади с заданным периметром и т. п.

Пусть функционал  имеет интегральный вид[1]

имеет интегральный вид[1]

![{\displaystyle F[\phi ]=\int _{a}^{b}L(\phi ,{\dot {\phi }},t)dt}](https://wikimedia.org/api/rest_v1/media/math/render/svg/691b595b9c68364df0ddff4d1eb075b7472b830b)

Его первой вариацией называется выражение

![{\displaystyle \delta F=F[\phi +\delta \phi ]-F[\phi ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dc9054dd7d35991d5bf9dcfd714bc0598ffb4593)

Если она представима в виде

с точностью до величин второго порядка по  , то функция

, то функция  называется функциональной производной[2]

называется функциональной производной[2]  по

по  и обозначается

и обозначается  . Функционал при этом называют дифференцируемым.

. Функционал при этом называют дифференцируемым.

Конкретно в данной задаче  , но в общем случае ответ существенно зависит от постановки задачи и граничных условий.

, но в общем случае ответ существенно зависит от постановки задачи и граничных условий.

Вторая вариация

Если функционал дифференцируем, то можно определить аналог второй производной (в данном случае он скорее аналогичен матрице вторых частных производных). Раскладывая полную вариацию  до второго порядка по

до второго порядка по  и отбрасывая величины первого порядка, получим выражение, называемое второй вариацией функционала:

и отбрасывая величины первого порядка, получим выражение, называемое второй вариацией функционала:

Свойства

Функциональная производная по свойствам аналогична обычной. Например:

- Линейность.

- Тождество Лейбница.

- Разложение полной вариации по частным производным:

![{\displaystyle \delta F[\phi ,\psi ]={\frac {\delta F}{\delta \phi }}\delta \phi +{\frac {\delta F}{\delta \psi }}\delta \psi }](https://wikimedia.org/api/rest_v1/media/math/render/svg/e50dbcac391d0bd726b68720a85faac3065f52b9)

- В точке экстремума функционала его производная равна 0. Точка экстремума является точкой минимума (максимума), если вторая вариация — положительно (отрицательно) определённая квадратичная форма.

и так далее.

Примеры

Энтропия

Информационная энтропия дискретной случайной величины — это функционал функции вероятности.

![{\displaystyle {\begin{aligned}H[p(x)]=-\sum _{x}p(x)\log p(x)\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/96861966ca600ab501ab12eb13a187562581cff1)

Поэтому

![{\displaystyle {\begin{aligned}\left\langle {\frac {\delta H}{\delta p}},\phi \right\rangle &{}=\sum _{x}{\frac {\delta H[p(x)]}{\delta p(x')}}\,\phi (x')\\&{}=\left.{\frac {d}{d\epsilon }}H[p(x)+\epsilon \phi (x)]\right|_{\epsilon =0}\\&{}=-{\frac {d}{d\varepsilon }}\left.\sum _{x}[p(x)+\varepsilon \phi (x)]\log[p(x)+\varepsilon \phi (x)]\right|_{\varepsilon =0}\\&{}=\displaystyle -\sum _{x}[1+\log p(x)]\phi (x)\\&{}=\left\langle -[1+\log p(x)],\phi \right\rangle .\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d1497c79d458d1d7877003999d215ef6d408adc5)

Поэтому

![{\displaystyle {\frac {\delta H}{\delta p}}=-[1+\log p(x)].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/92f66f67ac10bf061ca56ae0733d5ea96ca7eba6)

Экспонента

Пусть

![{\displaystyle F[\varphi (x)]=e^{\int \varphi (x)g(x)dx}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8cf62da868a4878d3d5c56043e0e7947d1a3789f)

Используем в качестве пробной функции дельта-функцию:

![{\displaystyle {\begin{aligned}{\frac {\delta F[\varphi (x)]}{\delta \varphi (y)}}&{}=\lim _{\varepsilon \to 0}{\frac {F[\varphi (x)+\varepsilon \delta (x-y)]-F[\varphi (x)]}{\varepsilon }}\\&{}=\lim _{\varepsilon \to 0}{\frac {e^{\int (\varphi (x)+\varepsilon \delta (x-y))g(x)dx}-e^{\int \varphi (x)g(x)dx}}{\varepsilon }}\\&{}=e^{\int \varphi (x)g(x)dx}\lim _{\varepsilon \to 0}{\frac {e^{\varepsilon \int \delta (x-y)g(x)dx}-1}{\varepsilon }}\\&{}=e^{\int \varphi (x)g(x)dx}\lim _{\varepsilon \to 0}{\frac {e^{\varepsilon g(y)}-1}{\varepsilon }}\\&{}=e^{\int \varphi (x)g(x)dx}g(y).\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ec4bb807430d52bf84582815526969c5182132bb)

Поэтому

![{\displaystyle {\frac {\delta F[\varphi (x)]}{\delta \varphi (y)}}=g(y)F[\varphi (x)].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e78f30af55466f2e117b3dc25af74e86a2db308c)

Примечания

Литература

- Леви П. Конкретные проблемы функционального анализа. — М.: Наука, 1967. — 509 с.

![{\displaystyle F[\phi ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dd9fa24e7f45b9f56ab7b81433d1ff68e9bcb69a)

![{\displaystyle \lim _{\varepsilon \to 0}{\frac {F[\phi +\varepsilon \delta \phi ]-F[\phi ]}{\varepsilon }}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/eee3e0955951685ebe8356bfc3f25ffbc1efc236)

![{\displaystyle F[\phi ]=\int _{a}^{b}L(\phi ,{\dot {\phi }},t)dt}](https://wikimedia.org/api/rest_v1/media/math/render/svg/691b595b9c68364df0ddff4d1eb075b7472b830b)

![{\displaystyle \delta F=F[\phi +\delta \phi ]-F[\phi ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dc9054dd7d35991d5bf9dcfd714bc0598ffb4593)

![{\displaystyle \delta F[\phi ,\psi ]={\frac {\delta F}{\delta \phi }}\delta \phi +{\frac {\delta F}{\delta \psi }}\delta \psi }](https://wikimedia.org/api/rest_v1/media/math/render/svg/e50dbcac391d0bd726b68720a85faac3065f52b9)

![{\displaystyle {\begin{aligned}H[p(x)]=-\sum _{x}p(x)\log p(x)\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/96861966ca600ab501ab12eb13a187562581cff1)

![{\displaystyle {\begin{aligned}\left\langle {\frac {\delta H}{\delta p}},\phi \right\rangle &{}=\sum _{x}{\frac {\delta H[p(x)]}{\delta p(x')}}\,\phi (x')\\&{}=\left.{\frac {d}{d\epsilon }}H[p(x)+\epsilon \phi (x)]\right|_{\epsilon =0}\\&{}=-{\frac {d}{d\varepsilon }}\left.\sum _{x}[p(x)+\varepsilon \phi (x)]\log[p(x)+\varepsilon \phi (x)]\right|_{\varepsilon =0}\\&{}=\displaystyle -\sum _{x}[1+\log p(x)]\phi (x)\\&{}=\left\langle -[1+\log p(x)],\phi \right\rangle .\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d1497c79d458d1d7877003999d215ef6d408adc5)

![{\displaystyle {\frac {\delta H}{\delta p}}=-[1+\log p(x)].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/92f66f67ac10bf061ca56ae0733d5ea96ca7eba6)

![{\displaystyle F[\varphi (x)]=e^{\int \varphi (x)g(x)dx}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8cf62da868a4878d3d5c56043e0e7947d1a3789f)

![{\displaystyle {\begin{aligned}{\frac {\delta F[\varphi (x)]}{\delta \varphi (y)}}&{}=\lim _{\varepsilon \to 0}{\frac {F[\varphi (x)+\varepsilon \delta (x-y)]-F[\varphi (x)]}{\varepsilon }}\\&{}=\lim _{\varepsilon \to 0}{\frac {e^{\int (\varphi (x)+\varepsilon \delta (x-y))g(x)dx}-e^{\int \varphi (x)g(x)dx}}{\varepsilon }}\\&{}=e^{\int \varphi (x)g(x)dx}\lim _{\varepsilon \to 0}{\frac {e^{\varepsilon \int \delta (x-y)g(x)dx}-1}{\varepsilon }}\\&{}=e^{\int \varphi (x)g(x)dx}\lim _{\varepsilon \to 0}{\frac {e^{\varepsilon g(y)}-1}{\varepsilon }}\\&{}=e^{\int \varphi (x)g(x)dx}g(y).\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ec4bb807430d52bf84582815526969c5182132bb)

![{\displaystyle {\frac {\delta F[\varphi (x)]}{\delta \varphi (y)}}=g(y)F[\varphi (x)].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e78f30af55466f2e117b3dc25af74e86a2db308c)